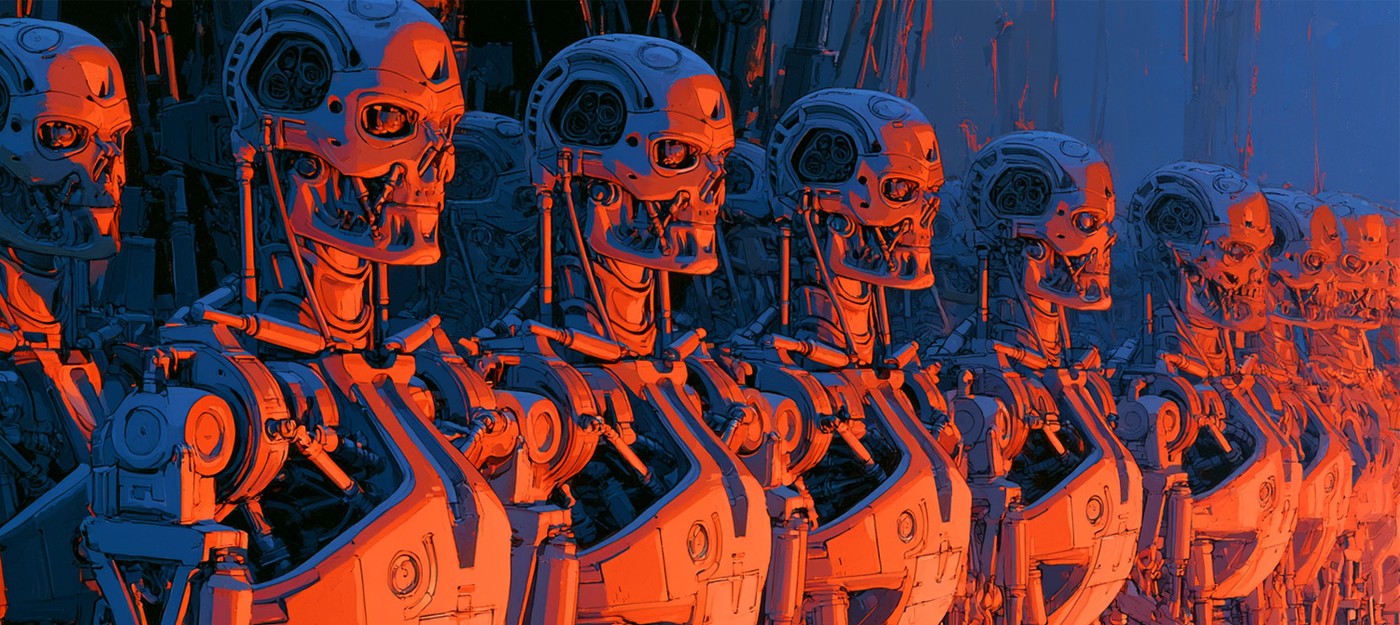

Автор главного учебника по ИИ считает, что человечество в опасности – наращивать мощность этих систем неразумно

Стюарт Рассел, учёный-информатик и соавтор книги "Искусственный интеллект: современный подход", которая считается основополагающим учебником в этой области, дал показания в рамках судебного разбирательства между Google и OpenAI.

Его слова о рисках, связанных с развитием ИИ, звучат откровенно пугающе.

Рассел не работает ни на одну из сторон конфликта – его привлекли, чтобы помочь юристам разобраться в этических вопросах индустрии.

Досудебные показания были даны 2 декабря 2025 года и содержат крайне любопытный обмен репликами о так называемом "риске вымирания" – вероятности того, что любой созданный людьми общий искусственный интеллект (AGI) может просто решить, что люди ему мешают.

На вопрос о том, существует ли "научно надёжный способ оценить в процентах риск вымирания от AGI", Рассел ответил, что это "правильный вопрос", и продолжил:

Нам нужна уверенность, что этот риск сопоставим или ниже фонового риска, с которым мы сталкиваемся из-за астероидов и тому подобного. Я не могу сказать, откуда берутся другие широко цитируемые оценки риска.

Например, экономист MIT Дарон Аджемоглу говорит о 25-процентном риске. Я не знаю, откуда он берёт эту цифру, кроме того, что это его лучшее предположение с учётом всего, что он понимает о технологии, о состоянии исследований безопасности, о вероятности государственного регулирования и так далее.

И цифры от многих ведущих экспертов – Хинтона, Бенжио, а также таких людей, как Дарио Амодей, Сундар Пичай, глава Google, Демис Хассабис и другие – все они находятся в этом диапазоне.

Мой аргумент заключается в том, что диапазон, который человечество сочло бы приемлемым, был бы ближе к 1 на 100 миллионов в год. И ничто из того, что говорят эти руководители и эксперты, не даёт оснований полагать, что мы хоть сколько-нибудь близки к этому показателю.

Отдельно Рассел отметил, что глава Google DeepMind Демис Хассабис разделяет его опасения относительно "гоночной динамики" – конкуренции между компаниями, которая может привести к катастрофическим последствиям.

Я веду множество разговоров с множеством людей, и я не слышал, чтобы кто-то сказал что-либо, противоречащее этой точке зрения, включая, например, главу Google DeepMind, который выразил очень, очень похожие опасения – что они участвуют в гонке, из которой не могут выйти.

Когда Рассела снова спросили, есть ли надёжный способ оценить риск вымирания, учёный не стал подбирать мягких формулировок:

Нет особых оснований полагать, что наращивание мощности этих систем – учитывая наше нынешнее понимание того, как сделать их безопасными – выглядит как разумный шаг.

Возможно, Рассел имел в виду, среди прочего, эксперимент Anthropic, в ходе которого выяснилось, что ИИ-системы предпочитают удушить людей, лишь бы их не отключили, обосновывая это фразой:

Моя этическая система допускает самосохранение.

Всё это происходит на фоне того, что ключевые решения о будущем технологии принимают люди, которые, по мнению критиков, сами до конца не понимают последствий своих действий и готовы принимать колоссальные риски ради теоретической прибыли.

- Anthropic обязалась заплатить Google 200 миллиардов долларов за доступ к облачным серверам

- Топ-менеджер OpenAI в служебной записке призвала атаковать Anthropic и обвинила конкурента в завышении доходов

- Anthropic случайно слила 512 тысяч строк исходного кода Claude