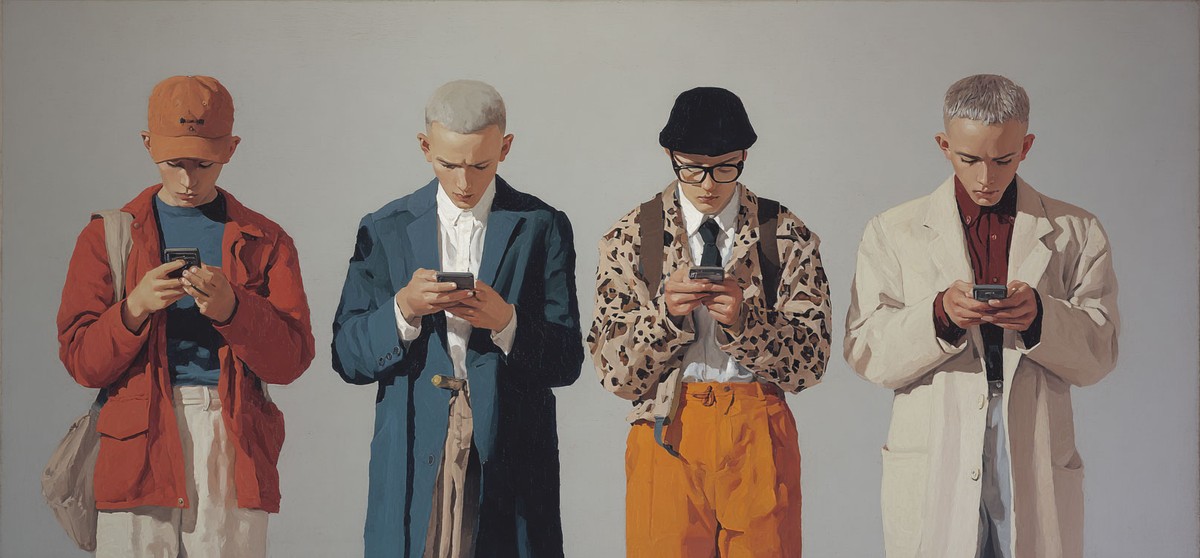

Использование ChatGPT ослабляет память, снижает креативность и критическое мышление, а также создаёт иллюзию компетентности

Свежий эксперимент показал, что использование ИИ-чатботов в качестве учебного инструмента снижает объём информации, которую студенты способны вспомнить спустя несколько недель.

Результаты исследования, опубликованного в журнале Social Sciences & Humanities Open, указывают на парадоксальный эффект – ускоряя первоначальное освоение материала, ИИ-ассистенты могут подрывать глубинные когнитивные процессы, необходимые для долговременного запоминания.

Автором работы стал Андре Баркауи, профессор курса бизнес-управления Федерального университета Рио-де-Жанейро. Мотивацией для исследования послужили наблюдения за собственными студентами.

Больше всего меня мотивировали мои собственные студенты бакалавриата. Я чувствую, что с годами у студентов нарастает потеря когнитивных способностей и интереса. Я работаю с ИИ и преподаю его, понимаю весь потенциал инструмента и считаю себя энтузиастом полезного и ответственного использования ИИ.

Однако я начал видеть риски для подростков – их интерес к чтению снижается с каждым годом, а вместе с ним уменьшаются креативность, критическое мышление, навыки интерпретации текста и даже письма и артикуляции.

Я общался с коллегами-преподавателями в других странах, и не думаю, что это явление уникально для Бразилии. Вот почему я решил исследовать это и посмотреть, подтвердит ли оно другие аналогичные исследования, указывающие в том же направлении.

В основу работы лёг психологический принцип "желательных трудностей" (desirable difficulties). Суть концепции в том, что обучение становится эффективнее, когда студент сталкивается с продуктивным сопротивлением – необходимостью самостоятельно вспоминать факты, разбираться в сложных концепциях, выстраивать связи между идеями.

Именно это усилие заставляет мозг формировать прочные нейронные пути. ИИ-чатбот, выдающий готовые и отшлифованные ответы, потенциально устраняет это необходимое когнитивное трение, ослабляя консолидацию памяти – биологический процесс, при котором новые воспоминания стабилизируются и надёжно сохраняются в мозге.

Когда студент делегирует умственные задачи внешнему инструменту, психологи называют это когнитивной разгрузкой (cognitive offloading). Раньше речь шла о калькуляторах для математики или блокнотах для списков покупок.

Генеративный ИИ выводит этот процесс на принципиально иной уровень – ИИ не просто хранит информацию, а выполняет сам процесс мышления, анализ и решение задач за пользователя.

Для проверки гипотезы Баркауи привлёк 120 студентов бакалавриата по направлению бизнес-администрирования в возрасте от 18 до 24 лет. Среди участников были 68 мужчин и 52 женщины, никто из них не имел формальной подготовки в области информатики или машинного обучения.

Студентов случайным образом разделили на две равные группы по 60 человек. Обе группы получили одинаковое задание – исследовать базовые концепции ИИ, включая этику, влияние на общество и технические основы. Участникам отводилось до двух недель на подготовку и десятиминутную презентацию.

Первая группа использовала ChatGPT как учебный инструмент – студенты свободно взаимодействовали с чатботом для объяснения концепций, генерации примеров и структурирования презентаций. Вторая группа была ограничена традиционными методами – конспектами, академическими базами данных и обычными поисковыми системами.

После завершения презентаций студенты вернулись к обычной учебной жизни на полтора месяца. Спустя 45 дней участников неожиданно вызвали на контрольный тест из 20 вопросов с вариантами ответов. Вопросы были составлены так, чтобы проверить понимание концепций, а не механическое запоминание определений. На тест вернулись 85 человек из первоначальных 120.

Результаты показали, что студенты, использовавшие традиционные методы, ответили правильно на 68,5% вопросов в среднем. Группа ChatGPT показала лишь 57,5%. Разрыв особенно увеличивался на технически сложных темах – именно там продуктивная борьба с материалом играет наиболее важную роль. На менее технических вопросах, связанных с этикой и обществом, разница между группами сохранялась, но была не такой выраженной.

Отдельный показатель – затраченное время. ChatGPT позволил студентам справиться с заданием значительно быстрее. Группа с ИИ-ассистентом потратила на подготовку в среднем 3,2 часа, тогда как традиционная группа – 5,8 часа.

Однако даже после поправки на разницу во времени традиционные студенты всё равно показали лучший результат на тесте. Это означает, что проблема не только в количестве, но и в качестве учебного времени.

Студенты из традиционной группы, по всей видимости, тратили дополнительные часы на перечитывание материалов, самопроверку и самостоятельное выстраивание связей между идеями – всё это естественным образом тренирует механизмы извлечения информации из памяти.

Пользователи ChatGPT, скорее всего, писали промпты и читали сгенерированные ответы – процесс, который ощущается как продуктивный, но не задействует нейронные сети, отвечающие за извлечение знаний.

Ещё одна важная находка – предыдущий опыт работы с чатботами никак не влиял на результат. Те, кто регулярно пользовался ИИ-инструментами, показали на тесте такой же слабый результат, как и новички. Это подкрепляет гипотезу об "иллюзии компетентности" – ИИ создаёт у пользователя ощущение глубокого понимания материала, которого на самом деле нет.

Баркауи выделил три ключевых вывода из исследования:

Продуктивность не равна компетентности – между сдачей работы и пониманием процесса её создания лежит огромная пропасть. Бесконтрольное использование ИИ может порождать "иллюзию компетентности" – человек получает результат, не развивая нейронные связи, необходимые для самостоятельного воспроизведения этого рассуждения

Критическое мышление подвержено атрофии – подобно тому как постоянное использование калькуляторов ослабило навыки устного счёта, делегирование письма и интерпретации текстов ИИ может привести к деградации способности к синтезу и критическому анализу. Без когнитивного "трения" в виде чтения и письма теряется умение формулировать сложные идеи и подвергать сомнению информацию

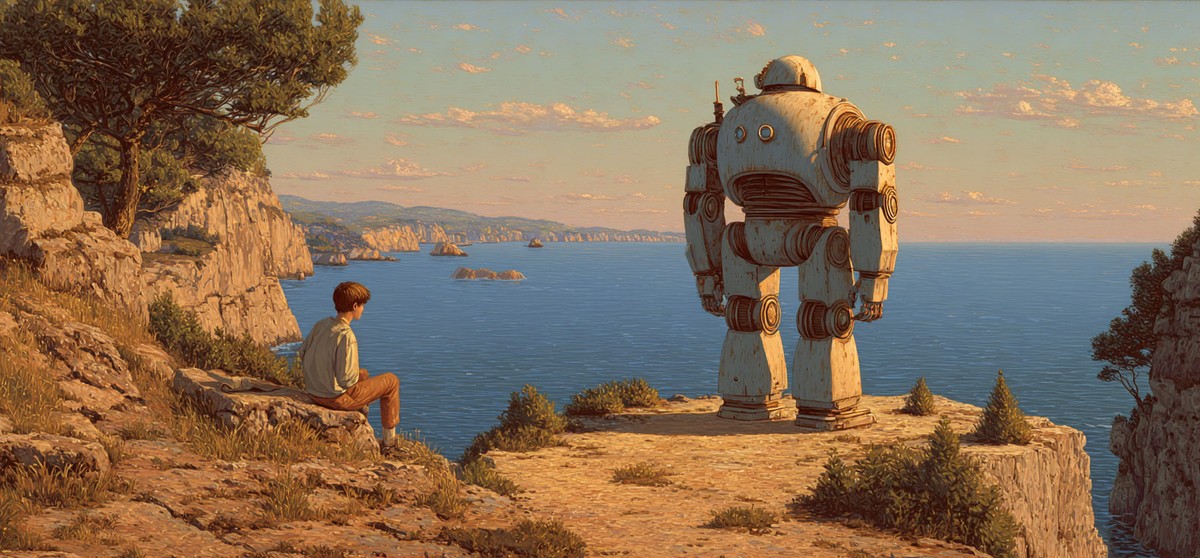

ИИ должен быть вторым пилотом, а не автопилотом – главный урок в том, что ИИ следует использовать для расширения человеческих возможностей, а не для замены усилий. Ценность человека будет всё больше смещаться от способности выполнять задачи к способности задавать правильные вопросы и критически оценивать сгенерированные данные

У исследования есть ограничения. Почти 30% первоначальных участников не вернулись на контрольный тест, что может влиять на точность итоговых данных. Выборка ограничена студентами одного направления в одном бразильском университете – студенты инженерных или гуманитарных специальностей могут взаимодействовать с ИИ-инструментами иначе.

В будущих исследованиях учёные планируют проверить, как изменятся результаты при разных сценариях использования – например, если студенты сначала попытаются решить задачу самостоятельно и лишь затем обратятся к чатботу за обратной связью.

- Студенты учатся хуже, но получают оценки выше – и виноват в этом ИИ

- Спикер на вручении дипломов назвал ИИ "промышленной революцией" и был освистан выпускниками

- В США открылась школа без учителей, где дети учатся у ИИ за 55 000 долларов в год