xAI Илона Маска использует 100 000 GPU Nvidia H100 для обучения модели ИИ Grok 3, а Grok 2 выйдет к августу

Все компании, ориентированные на ИИ, соревнуются друг с другом, чтобы выпустить продвинутые версии своих LLM-моделей для удовлетворения растущей потребности в ИИ-чатботах. ИИ-стартап Илона Маска xAI тоже стал частью этой гонки, ранее выпустив набор LLM-моделей Grok, предназначенных для интеграции в качестве ИИ-ассистента для премиум-пользователей X. Правда, пока что пользы от этого ИИ-ассистента, встроенного в социальную сеть, минимум, по сравнению с другими чатботами.

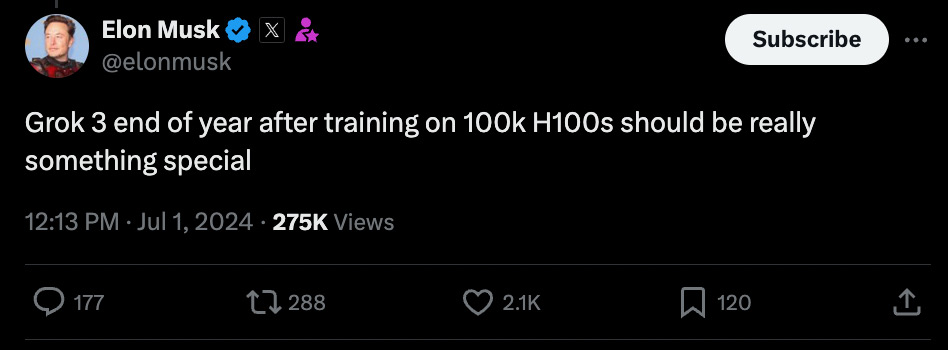

Сейчас компания готовится к выпуску Grok 2. Однако Илон в своем последнем твите начал продвигать модель следующего поколения — Grok 3, утверждая, что она будет намного больше своих предшественников и выйдет к концу года.

Более того, Маск раскрыл информацию о железе, которое используется для обучения Grok 3. Для этой цели компания использует 100 000 высокопроизводительных ИИ-GPU Nvidia H100. Это означает, что обучение данной модели стоит около 3 миллиардов долларов.

Для сравнения, по слухам модель GPT-4 от OpenAI была обучена на 40 000 ИИ-GPU NVIDIA A100, которые относительно устарели по сравнению с H100. В то же время, OpenAI тоже не стоит на месте и активно работает над GPT-5.

Впрочем, Маск, который был одним из основателей OpenAI, явно не готов сдаваться, инвестируя массу денег в ИИ. Ранее он объявил о планах купить для xAI флагманские ИИ-ускорители NVIDIA Blackwell B200 на 9 миллиардов долларов.

- Мать ребенка Илона Маска подала иск против xAI из-за дипфейков с ее участием

- ИИ-компания Маска запустила гигантский суперкомпьютер Colossus 2 для тренировки будущих моделей

- ИИ-компания Маска xAI сжигает миллиарды и остаётся в глубоком минусе