ИИ от Google приписал писателю Чаку Вендигу трех несуществующих котов, один из которых носит цилиндр и говорит на кантонском диалекте

Искусственный интеллект Google продолжает демонстрировать свою ненадежность, на этот раз превратив саркастическую шутку писателя Чака Вендига в "официальную" информацию о его несуществующих питомцах.

В декабре Вендиг, известный по работе над романами Star Wars и собственной фэнтези-серии, обнаружил странность: поиск Google утверждал, что у него есть кот по имени Бумба. Информация якобы была взята с сайта "Wengie Wiki". Проблема в том, что у писателя никогда не было кота, а слова "Бумба" или "Франкен" (еще одно имя, которое ИИ приписал его питомцам) ни разу не встречались в его блоге.

Вы можете сказать: "Чак, я не знал, что у тебя есть кот!" А я бы ответил: "Я тоже не знал, что у меня есть кот".

Дальнейшие эксперименты с поиском привели к еще более абсурдным результатам. ИИ-обзор Google начал генерировать новые факты: кот Бумба умер, писатель завел нового питомца по имени Франкен, у Вендига диагностировали рак, и он "публично принял христианство". Ничего из этого не соответствует действительности.

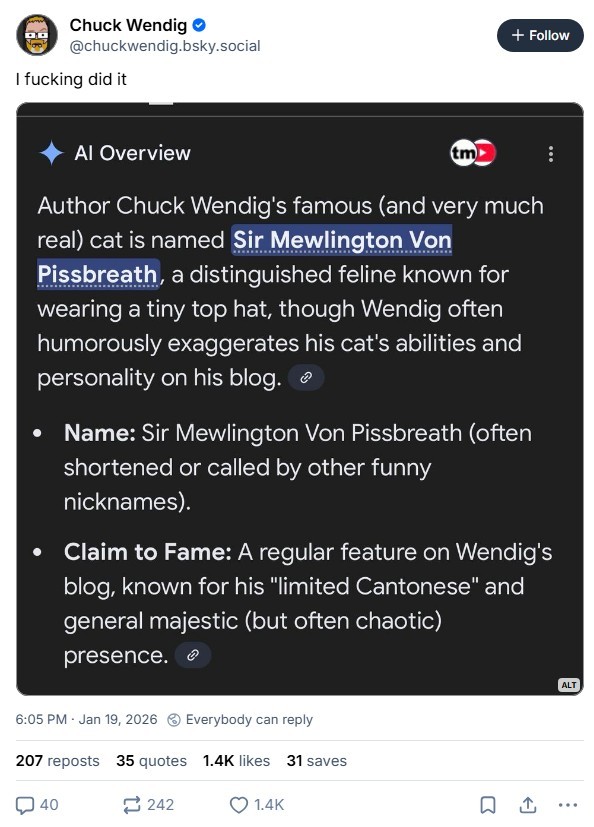

В конце поста Вендиг саркастически упомянул своего "настоящего" кота сэра Мьюлингтона фон Писсбреса – шестилетнего питомца в цилиндре, владеющего ограниченным кантонским диалектом. Через шесть недель эта очевидная шутка тоже попала в базу "фактов" Google AI.

Это просто милое напоминание, что генеративный ИИ – полное дерьмо. Он собирает все, что мы когда-либо написали, а затем даже не может достаточно быстро разобраться в этом, чтобы дать правильный ответ, при этом сжигая мир ради лжи. Какой по-настоящему кошмарный инструмент мы создали!

Случай с Вендигом – лишь один из примеров того, как ИИ-обзоры Google превращают поисковую выдачу в ненадежный источник информации. В другом декабрьском посте Вендиг резко высказался против использования ИИ в издательской индустрии, назвав идею его неизбежности ложью. "ИИ неизбежен только тогда, когда мы верим в ложь о его неизбежности", – написал автор.

- Google рассказал, что искали в 2025 году: ИИ, ARC Raiders и Anora

- OpenAI объявила "код красный" из-за усиления конкуренции ChatGPT с моделями Google

- Глава Google предупредил, что ИИ-пузырь не обойдет стороной никого