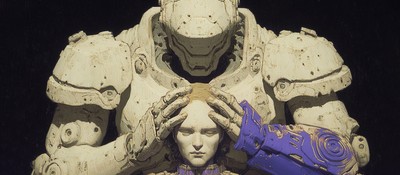

Армия США уверяет, что робот-танк будет подчиняться правилам поведения ИИ

В прошлом году армия США предложила частным компаниям разработать идеи по улучшению запланированного полуавтоматического робота-танка, оснащенного системой прицеливания на основе ИИ. В запросе армия попросила помощи с "обнаружением, идентификацией и взаимодействием с целями как минимум в 3 раза быстрее, чем нынешний ручной процесс". Что напугало людей — так это язык, каким армия оформила запрос, вызывая страх, что продвинутый ИИ в роботах-танках представляет опасность для человечества.

В ответ на эту реакцию представители вооруженных сил внесли объяснительные заметки, которые гласят, что полноценные автономные машины убийства не будут убивать людей налево и направо. Потому что существуют правила и установки, которым роботы будут обязаны следовать.

Это не значит, что департамент обороны перестанет создавать роботов-убийц, но эти машины должны включать этические стандарты.

Директива 3000.09 гласит, что люди должны иметь возможность определять необходимый уровень использования силы — то есть роботов не будут просто так забрасывать в область боевых действий, чтобы они сами разбирались с происходящим. Проще говоря, суть в том, что люди выносят окончательное решение по убийству той или иной цели.

Как долго будут активны подобные практики? Скорее всего, лицо военных действий в ближайшие 10-20 лет значительно поменяется — столкновения будут еще более локальными, а вести боевые действия будут в первую очередь роботы. А значит нам потребуются гарантии, что роботы не станут выходить из-под контроля.

Вы же помните "Терминатора"?!