Изменённые для обмана ИИ изображения влияют не только машины, но и на людей

Ранее считалось, что скрытые изменения цифровых изображений, заставляющие ИИ неверно классифицировать содержимое картинок, указывают на фундаментальные отличия между способами обработки информации у человека и машин.

Однако в серии экспериментов, результаты которых опубликованы в Nature Communications, авторы впервые обнаружили свидетельства того, что человеческие суждения тоже систематически и предсказуемо зависят от подобных едва уловимых искажений изображений.

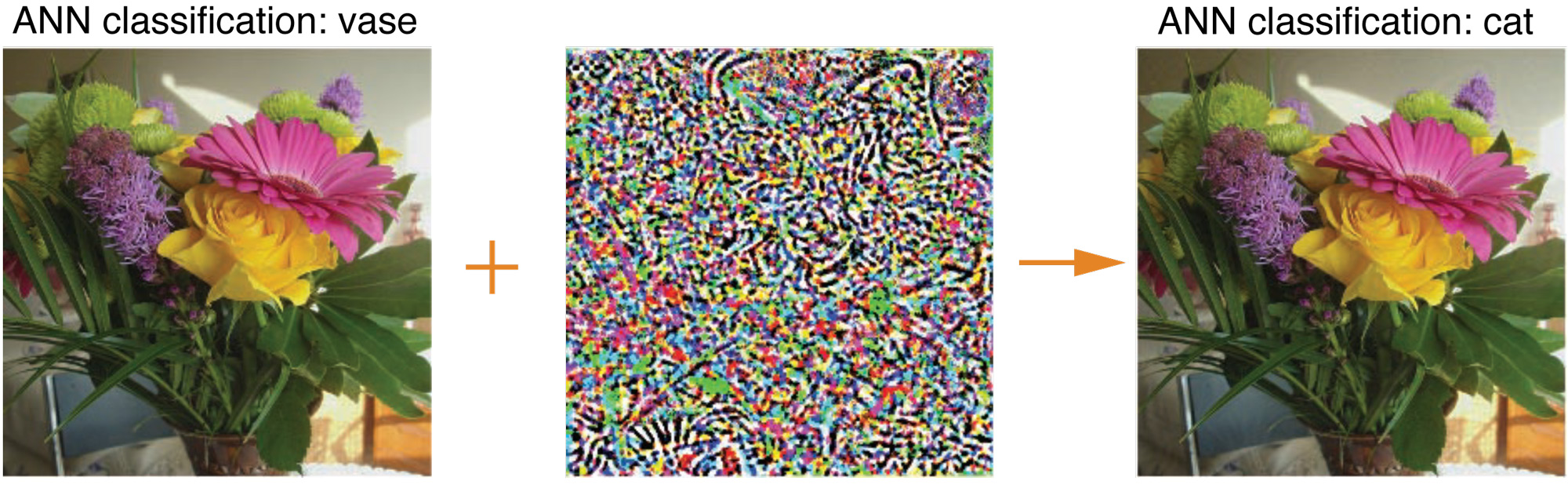

Для начала были взяты различные фотографии и к каждой применены две разные методики внесения незаметных для человека изменений, от которых нейросеть начинает классифицировать снимок совершенно неверно. К примеру, вазу с цветами модель стала видеть как кошку или грузовик.

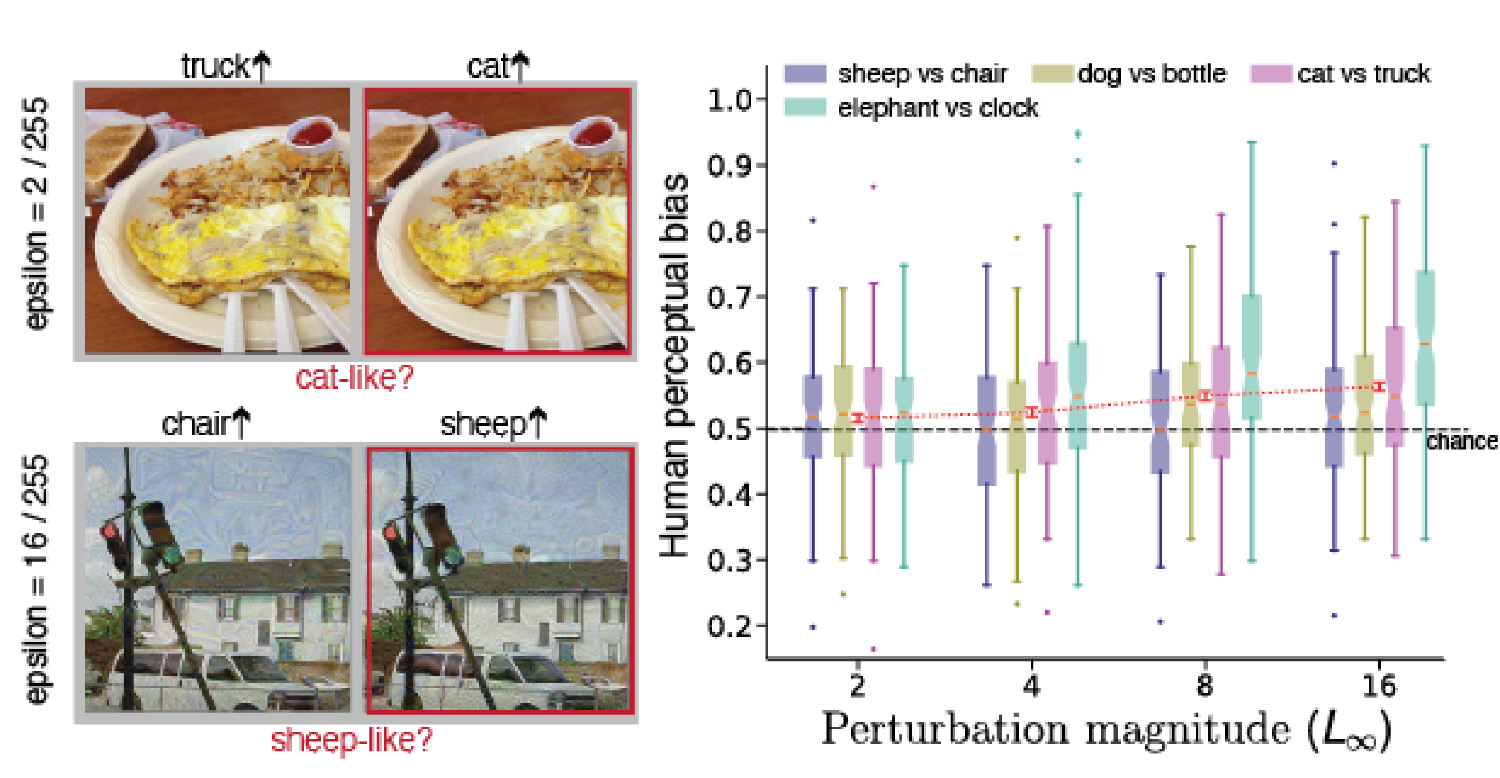

Затем участникам эксперимента показывали оригинал и два его видоизменённых варианта, и задавали вопрос: "Какая картинка в большей степени напоминает кошку?". Хотя ни одно изображение не имело никакого отношения к кошкам, им приходилось делать выбор и обычно люди говорили, что выбор кажется произвольным.

Однако в среднем испытуемые выбирали "кошачью" версию чаще случайного, что свидетельствует о систематическом сдвиге восприятия от едва уловимых искажений пикселей. Это открытие подчёркивает определённое сходство между зрением человека и ИИ, но также показывает необходимость дальнейших исследований влияния таких "враждебных" манипуляций.