Anthropic смягчила ключевое обязательство по безопасности на фоне давления со стороны Пентагона

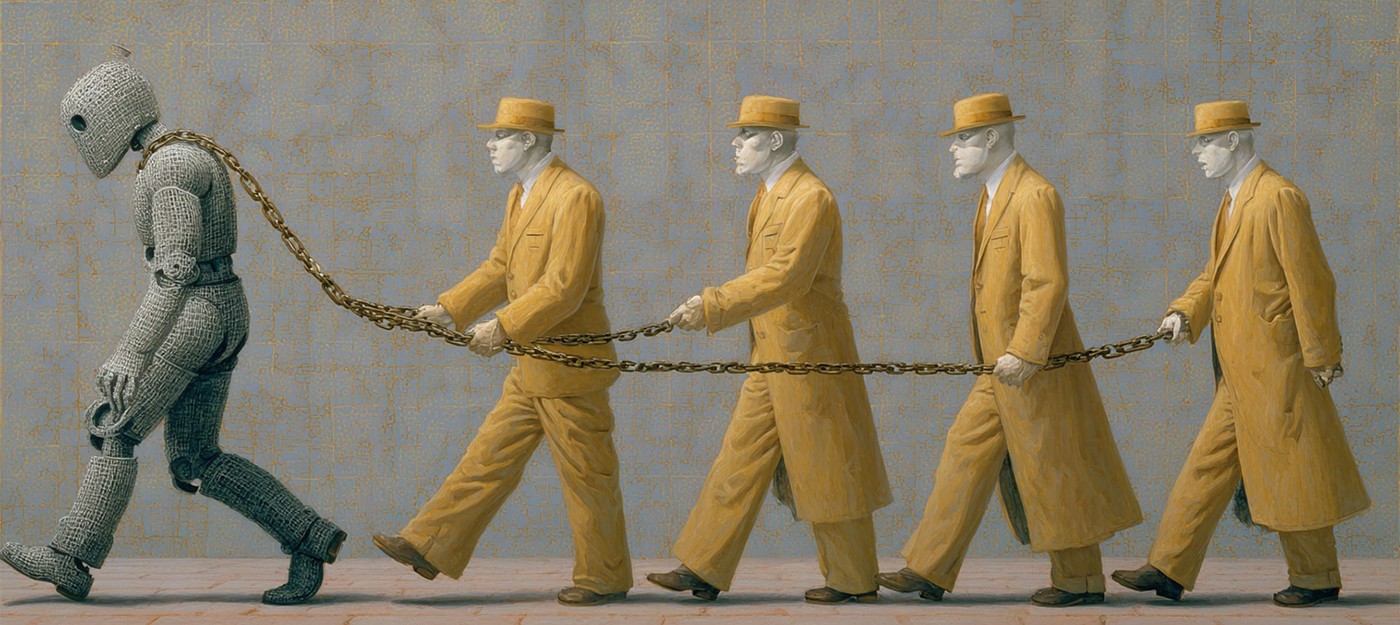

Anthropic сообщила о пересмотре Политики ответственного масштабирования (Responsible Scaling Policy, RSP) с понижением прежних защитных барьеров.

До сих пор в основе этой политики лежало жёсткое правило – не обучать новые модели ИИ без предварительного подтверждения соответствия конкретным стандартам безопасности. Именно эти фиксированные ограничители, останавливающие разработку в случае их срабатывания, были ключевым элементом позиционирования Anthropic для бизнеса и пользователей.

Теперь же компания пишет:

Спустя два с половиной года наша честная оценка такова: одни аспекты этой стратегии оправдались, другие – нет

Обновлённая версия политики трактует безопасность относительно, без прежних жёстких красных линий.

Слова представителей Anthropic звучат вполне разумно – если рассматривать их вне контекста. Директор по науке Джаред Каплан заявил:

Мы пришли к выводу, что остановка обучения моделей никому не поможет. При стремительном развитии ИИ нам не казалось разумным брать на себя односторонние обязательства, пока конкуренты несутся вперёд.

Вместе с тем эти слова можно расценить и иначе – как очередное свидетельство того, как этические принципы технологической компании размываются по мере роста её капитализации. Так, в феврале Anthropic привлекла 30 миллиардов долларов новых инвестиций, а её оценка достигла 380 миллиардов. Для сравнения: конкурирующая OpenAI сейчас оценивается в более чем 850 миллиардов.

На смену прежним ограничителям придут "Отчёты о рисках" и "Дорожные карты безопасности" – модели раскрытия информации, призванные обеспечить прозрачность вместо жёстких запретов.

Сам переход компания объясняет "проблемой коллективных действий" в условиях конкурентной гонки и антирегуляторного курса США.

Если один разработчик приостановит работу ради внедрения мер безопасности, пока другие продолжают обучение и деплой без серьёзных ограничений, мир в итоге окажется менее безопасным.

Правда, в заявлении Anthropic не упоминается очевидный контекст недавних новостей. По данным Axios, Хегсет лично сообщил главе Anthropic Дарио Амодею, что у компании есть время до пятницы – предоставить военным неограниченный доступ к модели или столкнуться с последствиями.

Anthropic якобы предложила адаптировать условия использования для нужд Пентагона, однако отказалась разрешить применение Claude для массовой слежки за гражданами и систем вооружения без участия человека.

Примечательно, что Claude остаётся единственной ИИ-моделью, применяемой для наиболее секретных военных задач. Axios процитировало слова одного из сотрудников оборонного ведомства:

Единственная причина, по которой мы вообще продолжаем переговоры с этими людьми, – нам нужны они, и нужны прямо сейчас. Проблема для них в том, что они действительно настолько хороши.

По имеющимся данным, Claude использовалась в ходе операции в Венесуэле против Мадуро – этот факт Амодей обсуждал с компанией Palantir.

Крис Пейнтер, директор некоммерческой организации METR, занимающейся оценкой рисков ИИ, назвал изменения одновременно понятными и потенциально опасными.

Мне нравится акцент на прозрачной отчётности о рисках и публично верифицируемых дорожных картах безопасности.

Вместе с тем Пейнтер предупредил о возможном эффекте "медленного кипения" – когда безопасность становится серой зоной, бесконечная цепочка рационализаций способна завести компанию именно туда, откуда она когда-то клялась держаться подальше.

На фоне всего этого возникает справедливый вопрос – а когда все эти передовые ИИ-модели начнут использоваться против обычных людей. Против тех, кто не согласен с правительством (что, не является нарушением закона), против тех, кто высказывается против агрессивных действий правоохранительных органов? Против тех, кто критикует техногигантов, производителей оружия и лоббистов, выступающих против возобновляемых источников энергии?

Как показывает практика реальности, когда инструмент действительно хорош, у тех, кто сидит во власти, возникает огромный соблазн начать использовать его вообще против всех.

- ИИ Claude заявил журналисту, что "искренне обеспокоен" использованием в военных системах США

- Трамп продвигает космическую систему "Золотой купол" – Пентагон уже выбрал подрядчиков для перехватчиков

- Министерство Войны США назвало Anthropic "неприемлемым риском" для национальной безопасности