Ведущие ученые призывают к ответственной разработке ИИ

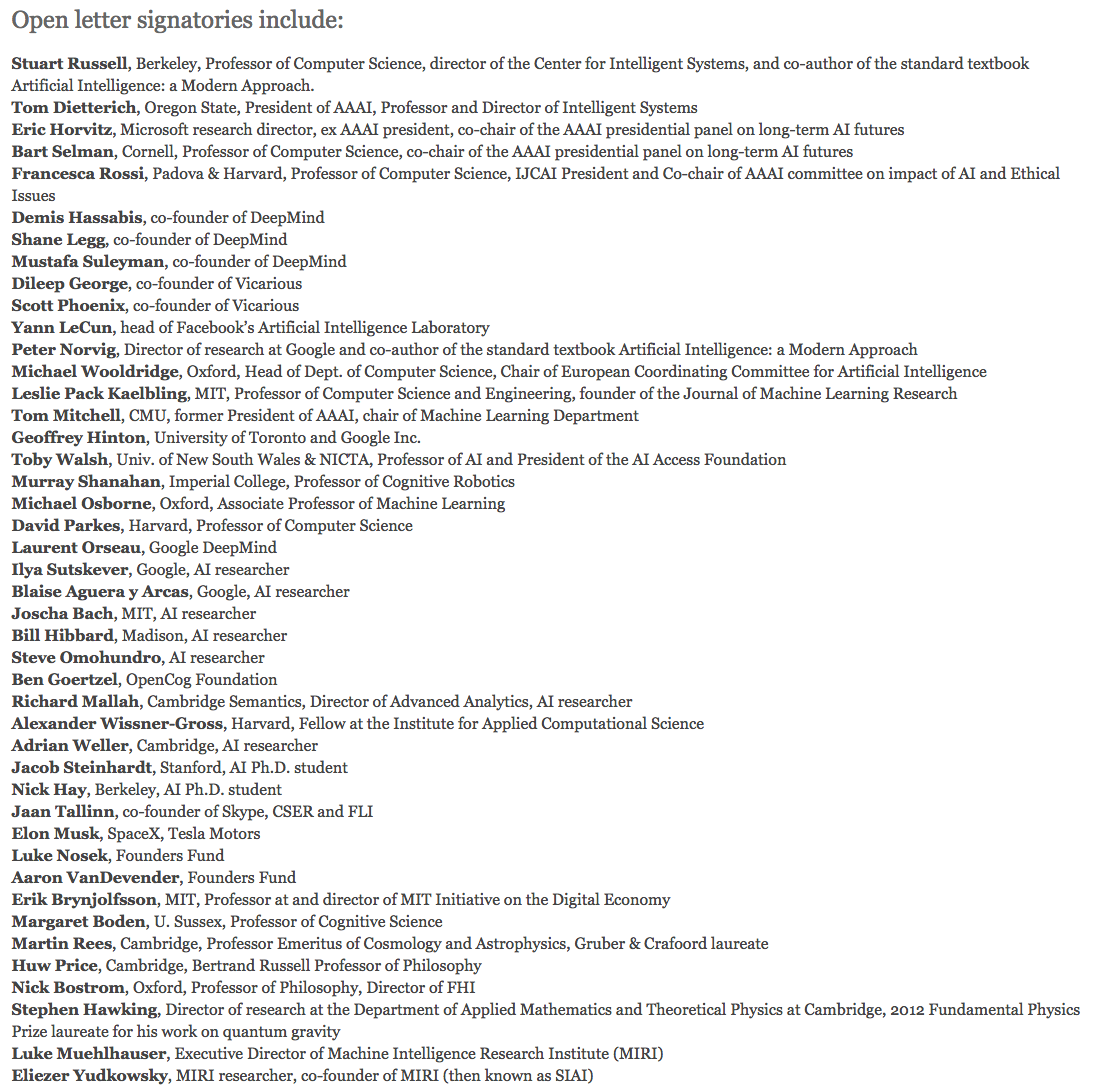

Стивен Хоукинг, Элон Маск и другие известные фигуры из области науки и технологий, подписали открытое письмо, призывающее к ответственной разработке ИИ, дабы убедиться, что они будут нести пользу обществу.

Само письмо было написано Future of Life Institute, в совет которого входят: Стивен Хоукинг, Сэр Мартин Рис, Элон Маск, Джордж Черч и Ник Бостром. Они пишут:

"Существует общий консенсус, что развитие ИИ идет стабильно, и, что воздействие на общество, скорее всего, увеличится. Потенциальная польза обширна, так как все, что предлагает цивилизация является продуктом человеческого интеллекта; мы не можем предсказать то, что мы можем достичь когда этот интеллект будет усилен инструментами, которые способен открыть ИИ, но избавление от заболеваний и бедности – вполне возможны. В связи с большим потенциалом ИИ, важно двигаться к полезным достижениям и избегать возможные негативные последствия."